YOLOv12による物体検出(COCO 80クラス)(ソースコードと説明と利用ガイド)

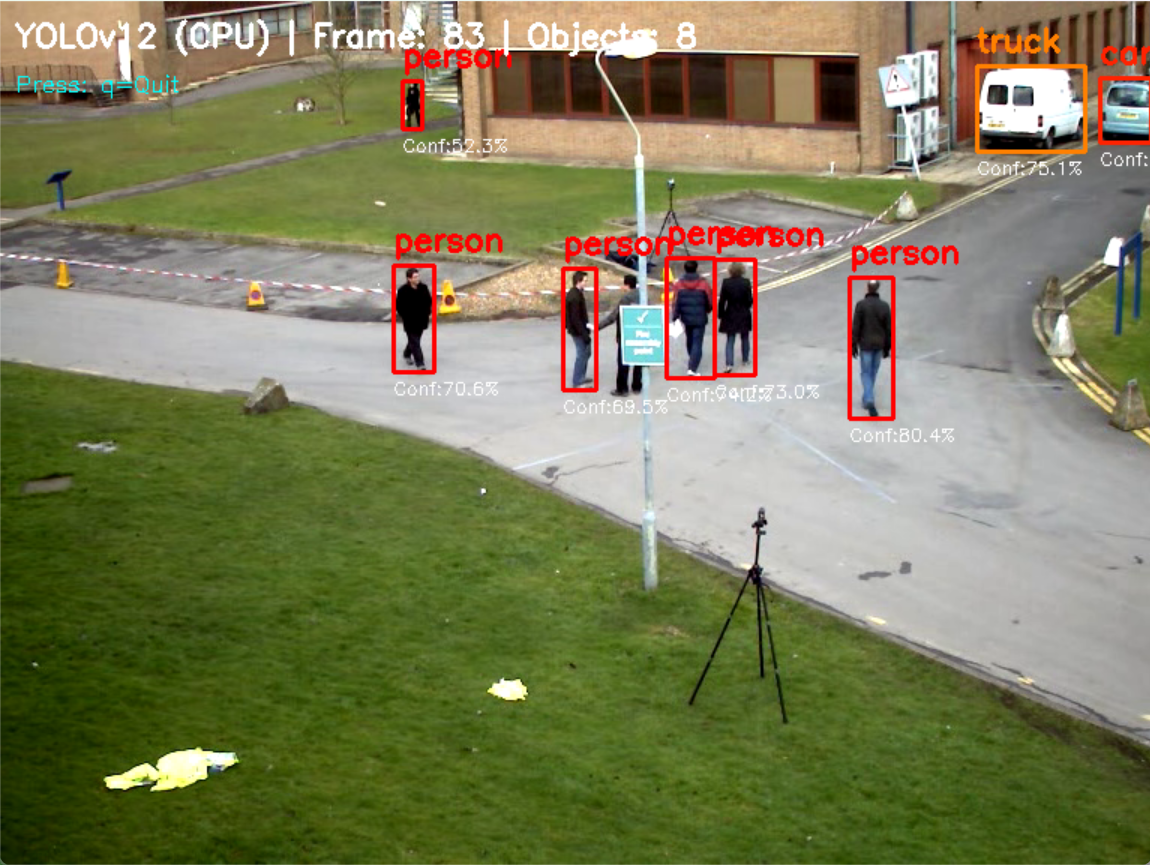

【概要】 YOLOv12を用いた物体検出プログラムである。動画ファイル、ウェブカメラ、サンプル動画から80種類の物体をリアルタイムで検出する。Area Attention機構により計算量を削減しながら高精度を実現。5段階のモデルサイズから選択可能である。CLAHE技術による画質前処理で低照度環境にも対応する。日本語表示対応、検出結果の自動保存機能を備える。

プログラム利用ガイド

1. このプログラムの利用シーン

動画やカメラ映像からリアルタイムで人物、車両、動物などの80種類のオブジェクトを自動検出するためのソフトウェアである。防犯監視、交通量調査、画像解析研究、機械学習の学習用データ作成などの用途に適用できる。日本語表示に対応し、検出結果を直感的に理解できる。

2. 主な機能

- リアルタイム物体検出: YOLOv12による80クラスのオブジェクト検出をリアルタイムで実行する。

- 複数入力対応: 動画ファイル、ウェブカメラ、サンプル動画の3つの入力ソースに対応する。

- モデル選択機能: nano、small、medium、large、extra largeの5つのモデルサイズから用途に応じて選択できる。

- 画質前処理: CLAHE技術による自動コントラスト調整で低照度環境でも検出精度を向上させる。

- GPU加速: CUDA対応GPU環境では自動的にGPU処理に切り替わる。

- 日本語対応: 検出オブジェクトのラベルを日本語で表示する(Pillowライブラリ使用)。

- 検出結果保存: フレーム毎の処理結果表示と終了時のテキストファイル保存機能を提供する。

3. 基本的な使い方

- モデル選択:

起動時に表示されるメニューから、n(nano)、s(small)、m(medium)、l(large)、x(extra large)のいずれかを入力する。

- 入力ソース選択:

0(動画ファイル)、1(カメラ)、2(サンプル動画)のいずれかを入力する。0を選択した場合はファイル選択ダイアログが表示される。

- 処理実行:

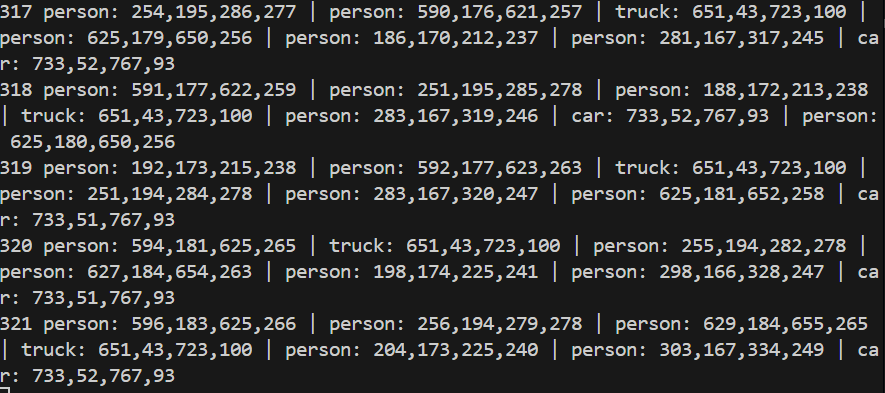

検出結果がリアルタイムで画面に表示される。各フレームの処理結果がコンソールに出力される。

- 終了方法:

映像表示ウィンドウでqキーを押すとプログラムが終了し、result.txtファイルに結果が保存される。

4. 便利な機能

- 自動環境検出: GPU搭載環境では自動的にCUDA処理に切り替わり、CPU環境でも動作する。

- 信頼度表示: 検出したオブジェクトごとに信頼度パーセンテージが表示される。

- 色分け表示: 80クラスのオブジェクトがそれぞれ異なる色のバウンディングボックスで表示される。

- 日本語ラベル: 検出オブジェクトが日本語名で表示され、結果ファイルにも日本語と英語の両方が記録される。

- 処理統計: フレーム数、検出オブジェクト数、使用モデル情報が画面上部に表示される。

- 結果ログ: プログラム終了時に全フレームの検出結果と検出クラス別統計がテキストファイルに自動保存される。

Python開発環境,ライブラリ類

ここでは、最低限の事前準備について説明する。機械学習や深層学習を行う場合は、NVIDIA CUDA、Visual Studio、Cursorなどを追加でインストールすると便利である。これらについては別ページ https://www.kkaneko.jp/cc/dev/aiassist.htmlで詳しく解説しているので、必要に応じて参照してください。

Python 3.12 のインストール

インストール済みの場合は実行不要。

管理者権限でコマンドプロンプトを起動(手順:Windowsキーまたはスタートメニュー > cmd と入力 > 右クリック > 「管理者として実行」)し、以下を実行する。管理者権限は、wingetの--scope machineオプションでシステム全体にソフトウェアをインストールするために必要である。

REM Python をシステム領域にインストール

winget install --scope machine --id Python.Python.3.12 -e --silent --accept-source-agreements --accept-package-agreements

REM Python のパス設定

set "PYTHON_PATH=C:\Program Files\Python312"

set "PYTHON_SCRIPTS_PATH=C:\Program Files\Python312\Scripts"

echo "%PATH%" | find /i "%PYTHON_PATH%" >nul

if errorlevel 1 setx PATH "%PATH%;%PYTHON_PATH%" /M >nul

echo "%PATH%" | find /i "%PYTHON_SCRIPTS_PATH%" >nul

if errorlevel 1 setx PATH "%PATH%;%PYTHON_SCRIPTS_PATH%" /M >nul【関連する外部ページ】

Python の公式ページ: https://www.python.org/

AI エディタ Windsurf のインストール

Pythonプログラムの編集・実行には、AI エディタの利用を推奨する。ここでは,Windsurfのインストールを説明する。

管理者権限でコマンドプロンプトを起動(手順:Windowsキーまたはスタートメニュー > cmd と入力 > 右クリック > 「管理者として実行」)し、以下を実行して、Windsurfをシステム全体にインストールする。管理者権限は、wingetの--scope machineオプションでシステム全体にソフトウェアをインストールするために必要となる。

winget install --scope machine --id Codeium.Windsurf -e --silent --accept-source-agreements --accept-package-agreements【関連する外部ページ】

Windsurf の公式ページ: https://windsurf.com/

必要なライブラリをシステム領域にインストール

コマンドプロンプトを管理者として実行(手順:Windowsキーまたはスタートメニュー > cmd と入力 > 右クリック > 「管理者として実行」)し、以下を実行する

pip install -U torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126

pip install ultralytics opencv-python numpy pillow

YOLOv12による物体検出プログラム(COCO 80クラス)

概要

このプログラムは、YOLOv12を用いたリアルタイム物体検出システムである。動画ファイル、カメラ、サンプル動画の3つの入力ソースに対応し、COCOデータセット80クラスの物体を検出してバウンディングボックスで表示する。GPU/CPU自動検出機能により環境に応じた最適化を行い、日本語表示に対応している。

主要技術

YOLOv12 (You Only Look Once version 12)

2025年にTian、Ye、Doermannによって開発されたAttention-Centric Real-Time Object Detectorsである[1]。従来のCNNベースのYOLOモデルとは異なり、Area Attention機構を中心とした設計により、リアルタイム性能を維持しながら検出精度を向上させる。

CLAHE (Contrast Limited Adaptive Histogram Equalization)

1994年にZuiderveldによって開発された適応的ヒストグラム均等化技術である[2]。画像を小さなタイルに分割し、各タイルに対して局所的にコントラスト強調を行う。過度な増幅を防ぐクリップ制限機能により、ノイズの増幅を抑制する。

技術的特徴

- Area Attention機構

特徴マップを水平または垂直方向に分割して局所的にAttentionを適用する。従来のグローバルAttentionと比較して計算量を削減しながら大きな受容野を維持する。

- 5段階のモデルサイズ対応

nano(3.2M)、small(11.2M)、medium(25.9M)、large(43.7M)、extra large(68.2M)の5つのモデルバリアントを提供し、用途に応じた精度と速度のバランス調整が可能である。

- CLAHE前処理による画質向上

YUV色空間でのCLAHE適用により、明度チャンネルの局所コントラストを強調する。clipLimit=2.0、tileGridSize=(8,8)のパラメータで過度な増幅を制御する。

- 日本語表示対応

Pillowライブラリを使用してメイリオフォントで日本語ラベルを描画する。80クラス全てに日本語名マッピングを実装している。

実装の特色

動画処理のリアルタイム要件に対応した以下の機能を備える:

- 3つの入力ソース選択(動画ファイル、カメラ、サンプル動画)

- 信頼度閾値による検出結果フィルタリング(デフォルト0.5)

- 検出オブジェクトの信頼度降順ソート表示

- フレーム毎の処理結果出力とプログラム終了時の結果ファイル保存

- CUDA/CPU自動検出によるハードウェア最適化

- クラス別色分けによる視認性向上(HSV色空間ベースの80色自動生成)

- 検出クラス別の統計情報出力

参考文献

[1] Tian, Y., Ye, Q., & Doermann, D. (2025). YOLOv12: Attention-Centric Real-Time Object Detectors. arXiv preprint arXiv:2502.12524. https://arxiv.org/abs/2502.12524

[2] Zuiderveld, K. (1994). Contrast Limited Adaptive Histogram Equalization. Graphics Gems IV (pp. 474-485). Academic Press Professional.

ソースコード

# プログラム名: YOLOv12物体検出プログラム(COCO 80クラス)

# 特徴技術名: YOLOv12 (You Only Look Once version 12)

# 出典: Tian, Yunjie and Ye, Qixiang and Doermann, David (2025). YOLOv12: Attention-Centric Real-Time Object Detectors. arXiv preprint arXiv:2502.12524. GitHub: https://github.com/sunsmarterjie/yolov12

# 特徴技術および学習済モデルの利用制限: AGPL-3.0ライセンス。商用利用時はライセンス条件の遵守が必要。必ず利用者自身で最新の利用制限を確認すること。

# 特徴機能: Area Attention機構による物体検出

# 学習済みモデル: yolo12n.pt (COCOデータセットで事前学習済み、80クラス対応、nanoバリアント、手動配置が必要)で、クラス0が人物(person)を検出可能

# モデルサイズ選択可能(デフォルト:n):

# n (nano): yolo12n.pt - 軽量

# s (small): yolo12s.pt - 軽量

# m (medium): yolo12m.pt - バランス型

# l (large): yolo12l.pt - 精度重視

# x (extra large): yolo12x.pt - 最大精度

# 方式設計:

# - 関連利用技術:

# - PyTorch: 深層学習フレームワーク、CUDA対応によるGPU加速

# - OpenCV: 画像処理、カメラ制御、描画処理、動画入出力管理

# - 入力と出力: 入力: 動画(ユーザは「0:動画ファイル,1:カメラ,2:サンプル動画」のメニューで選択.0:動画ファイルの場合はtkinterでファイル選択.1の場合はOpenCVでカメラが開く.2の場合はhttps://raw.githubusercontent.com/opencv/opencv/master/samples/data/vtest.aviを使用)、出力: OpenCV画面でリアルタイム表示(検出したオブジェクトをバウンディングボックスで表示)、フレーム毎のprint()による処理結果表示、プログラム終了時にresult.txtファイルに保存

# - 処理手順: 1.フレーム取得、2.前処理(CLAHE)、3.YOLOv12推論実行、4.信頼度閾値による選別、5.バウンディングボックス描画

# - 前処理、後処理: 前処理:CLAHE適用。YOLOv12内部で自動実行(640x640リサイズ、正規化)。後処理:信頼度による閾値フィルタリング

# - 追加処理: CUDA/CPU自動検出機能により、GPU搭載環境では自動的に処理実行。検出結果の信頼度降順ソートにより重要な検出を優先表示。カメラ入力時はスレッド化されたフレーム取得により処理遅延によるフレームドロップを防止

# - 調整を必要とする設定値: CONF_THRESH(オブジェクト検出信頼度閾値、デフォルト0.5)- 値を上げると誤検出が減少するが検出漏れが増加

# 将来方策: CONF_THRESHの動的調整機能。フレーム毎の検出数を監視し、検出数が閾値を超えた場合は信頼度を上げ、検出数が少ない場合は下げる適応的制御の実装

# その他の重要事項: Windows環境専用設計、CUDA対応GPU推奨(自動検出・CPUフォールバック機能付き)、初回実行時は学習済みモデルの手動配置が必要

# 前準備:

# - pip install -U torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126

# - pip install ultralytics opencv-python numpy pillow

import cv2

import tkinter as tk

from tkinter import filedialog

import torch

import numpy as np

import time

import urllib.request

from ultralytics import YOLO

from datetime import datetime

import sys

import io

from PIL import Image, ImageDraw, ImageFont

import threading

# Windows文字エンコーディング設定

sys.stdout = io.TextIOWrapper(sys.stdout.buffer, encoding='utf-8', line_buffering=True)

# GPU/CPU自動選択

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(f'デバイス: {str(device)}')

# GPU使用時の最適化

if device.type == 'cuda':

torch.backends.cudnn.benchmark = True

# ===== 設定・定数管理 =====

# モデル情報

MODEL_INFO = {

'n': {'name': 'Nano', 'desc': '軽量', 'params': '3.2M'},

's': {'name': 'Small', 'desc': '軽量', 'params': '11.2M'},

'm': {'name': 'Medium', 'desc': 'バランス型', 'params': '25.9M'},

'l': {'name': 'Large', 'desc': '精度重視', 'params': '43.7M'},

'x': {'name': 'Extra Large', 'desc': '最大精度', 'params': '68.2M'}

}

# 日本語クラス名マッピング

CLASS_NAMES_JP = {

'person': '人', 'bicycle': '自転車', 'car': '車', 'motorcycle': 'バイク',

'airplane': '飛行機', 'bus': 'バス', 'train': '電車', 'truck': 'トラック',

'boat': 'ボート', 'traffic light': '信号機', 'fire hydrant': '消火栓',

'stop sign': '停止標識', 'parking meter': 'パーキングメーター', 'bench': 'ベンチ',

'bird': '鳥', 'cat': '猫', 'dog': '犬', 'horse': '馬', 'sheep': '羊',

'cow': '牛', 'elephant': '象', 'bear': '熊', 'zebra': 'シマウマ', 'giraffe': 'キリン',

'backpack': 'リュック', 'umbrella': '傘', 'handbag': 'ハンドバッグ', 'tie': 'ネクタイ',

'suitcase': 'スーツケース', 'frisbee': 'フリスビー', 'skis': 'スキー板',

'snowboard': 'スノーボード', 'sports ball': 'ボール', 'kite': '凧',

'baseball bat': 'バット', 'baseball glove': 'グローブ', 'skateboard': 'スケートボード',

'surfboard': 'サーフボード', 'tennis racket': 'テニスラケット', 'bottle': 'ボトル',

'wine glass': 'ワイングラス', 'cup': 'カップ', 'fork': 'フォーク', 'knife': 'ナイフ',

'spoon': 'スプーン', 'bowl': 'ボウル', 'banana': 'バナナ', 'apple': 'リンゴ',

'sandwich': 'サンドイッチ', 'orange': 'オレンジ', 'broccoli': 'ブロッコリー',

'carrot': 'ニンジン', 'hot dog': 'ホットドッグ', 'pizza': 'ピザ', 'donut': 'ドーナツ',

'cake': 'ケーキ', 'chair': '椅子', 'couch': 'ソファ', 'potted plant': '鉢植え',

'bed': 'ベッド', 'dining table': 'テーブル', 'toilet': 'トイレ', 'tv': 'テレビ',

'laptop': 'ノートPC', 'mouse': 'マウス', 'remote': 'リモコン', 'keyboard': 'キーボード',

'cell phone': '携帯電話', 'microwave': '電子レンジ', 'oven': 'オーブン',

'toaster': 'トースター', 'sink': 'シンク', 'refrigerator': '冷蔵庫',

'book': '本', 'clock': '時計', 'vase': '花瓶', 'scissors': 'ハサミ',

'teddy bear': 'ぬいぐるみ', 'hair drier': 'ドライヤー', 'toothbrush': '歯ブラシ'

}

# COCO 80クラス名

COCO_CLASSES = list(CLASS_NAMES_JP.keys())

# クラスごとの色生成(HSVからBGRに変換)

def generate_colors(num_classes):

colors = []

for i in range(num_classes):

hue = int(180.0 * i / num_classes)

hsv = np.uint8([[[hue, 255, 255]]])

bgr = cv2.cvtColor(hsv, cv2.COLOR_HSV2BGR)[0][0]

colors.append((int(bgr[0]), int(bgr[1]), int(bgr[2])))

return colors

# 80クラス分の色を生成

CLASS_COLORS = generate_colors(80)

# BGR→RGB色変換のヘルパー関数

def bgr_to_rgb(color_bgr):

"""BGRカラーをRGBカラーに変換"""

return (color_bgr[2], color_bgr[1], color_bgr[0])

# 日本語フォント設定

FONT_PATH = 'C:/Windows/Fonts/meiryo.ttc'

FONT_SIZE_MAIN = 16

font_main = ImageFont.truetype(FONT_PATH, FONT_SIZE_MAIN)

SAMPLE_URL = 'https://raw.githubusercontent.com/opencv/opencv/master/samples/data/vtest.avi'

SAMPLE_FILE = 'vtest.avi'

# 調整可能な設定値

CONF_THRESH = 0.5

CLAHE_CLIP_LIMIT = 2.0

CLAHE_TILE_SIZE = (8, 8)

MAIN_FUNC_DESC = "YOLOv12 Object Detection (CLAHE)"

# CLAHEオブジェクトをグローバルスコープで一度だけ定義

clahe = cv2.createCLAHE(clipLimit=CLAHE_CLIP_LIMIT, tileGridSize=CLAHE_TILE_SIZE)

# グローバル変数

frame_count = 0

results_log = []

class_counts = {}

model = None

class ThreadedVideoCapture:

"""スレッド化されたVideoCapture(常に最新フレームを取得)"""

def __init__(self, src, is_camera=False):

if is_camera:

self.cap = cv2.VideoCapture(src, cv2.CAP_DSHOW)

fourcc = cv2.VideoWriter_fourcc('M', 'J', 'P', 'G')

self.cap.set(cv2.CAP_PROP_FOURCC, fourcc)

self.cap.set(cv2.CAP_PROP_FPS, 60)

else:

self.cap = cv2.VideoCapture(src)

self.grabbed, self.frame = self.cap.read()

self.stopped = False

self.lock = threading.Lock()

self.thread = threading.Thread(target=self.update, args=())

self.thread.daemon = True

self.thread.start()

def update(self):

"""バックグラウンドでフレームを取得し続ける"""

while not self.stopped:

grabbed, frame = self.cap.read()

with self.lock:

self.grabbed = grabbed

if grabbed:

self.frame = frame

def read(self):

"""最新フレームを返す"""

with self.lock:

return self.grabbed, self.frame.copy() if self.grabbed else None

def isOpened(self):

return self.cap.isOpened()

def get(self, prop):

return self.cap.get(prop)

def release(self):

self.stopped = True

self.thread.join()

self.cap.release()

def display_program_header():

print('=== YOLOv12オブジェクト検出プログラム (CLAHE) ===')

print('概要: リアルタイムでオブジェクトを検出し、バウンディングボックスで表示します')

print('機能: YOLOv12によるオブジェクト検出(COCOデータセット80クラス)')

print('操作: qキーで終了')

print('出力: 各フレームでの処理結果表示、終了時にresult.txt保存')

print()

# ===== 共通処理関数 =====

def draw_texts_with_pillow(bgr_frame, texts):

"""テキスト描画, texts: list of dict with keys {text, org, color, font_type}"""

img_pil = Image.fromarray(cv2.cvtColor(bgr_frame, cv2.COLOR_BGR2RGB))

draw = ImageDraw.Draw(img_pil)

for item in texts:

text = item['text']

x, y = item['org']

color = item['color']

draw.text((x, y), text, font=font_main, fill=color)

return cv2.cvtColor(np.array(img_pil), cv2.COLOR_RGB2BGR)

# ===== 物体検出タスク固有の処理 =====

def draw_detection_results(frame, objects):

"""物体検出の描画処理"""

for i, obj in enumerate(objects):

x1, y1, x2, y2 = obj['box']

class_id = obj['class_id']

color = CLASS_COLORS[class_id]

cv2.rectangle(frame, (x1, y1), (x2, y2), color, 2)

texts_to_draw = []

for obj in objects:

x1, y1, x2, y2 = obj['box']

class_id = obj['class_id']

class_name = obj['class_name']

jp_name = CLASS_NAMES_JP.get(class_name, class_name)

color = CLASS_COLORS[class_id]

label = f"{jp_name}: {obj['detection_conf']:.1%}"

texts_to_draw.append({

'text': label,

'org': (x1, y1-10),

'color': bgr_to_rgb(color),

'font_type': 'main'

})

frame = draw_texts_with_pillow(frame, texts_to_draw)

info1 = f'YOLOv12 ({MODEL_INFO[MODEL_SIZE]["name"]}) | Frame: {frame_count} | Objects: {len(objects)}'

info2 = 'Press: q=Quit'

cv2.putText(frame, info1, (10, 30), cv2.FONT_HERSHEY_SIMPLEX, 0.7, (255, 255, 255), 2)

cv2.putText(frame, info2, (10, 60), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (255, 255, 0), 1)

return frame

def format_detection_output(objects, is_camera, current_time):

"""物体検出の出力フォーマット"""

if is_camera:

prefix = datetime.fromtimestamp(current_time).strftime("%Y-%m-%d %H:%M:%S.%f")[:-3]

else:

prefix = f"Frame {frame_count}"

count = len(objects)

if objects:

obj_strs = []

for obj in objects:

x1, y1, x2, y2 = obj['box']

class_name = obj['class_name']

conf = obj['detection_conf']

obj_strs.append(f"class={class_name},conf={conf:.3f},box=[{x1},{y1},{x2},{y2}]")

result = f"{prefix}: count={count}; " + " | ".join(obj_strs)

else:

result = f"{prefix}: count={count};"

return result

def detect_objects(frame):

"""共通の検出処理(CLAHE、推論、検出を実行)"""

global model

H, W, _ = frame.shape

yuv_img = cv2.cvtColor(frame, cv2.COLOR_BGR2YUV)

yuv_img[:,:,0] = clahe.apply(yuv_img[:,:,0])

clahe_frame = cv2.cvtColor(yuv_img, cv2.COLOR_YUV2BGR)

results = model(clahe_frame, device=device, verbose=False)

objects = []

if results[0].boxes is not None:

boxes = results[0].boxes.xywh.cpu().numpy()

confs = results[0].boxes.conf.cpu().numpy()

classes = results[0].boxes.cls.cpu().numpy()

valid_indices = confs > CONF_THRESH

if np.any(valid_indices):

boxes = boxes[valid_indices]

confs = confs[valid_indices]

classes = classes[valid_indices]

boxes_xyxy = boxes.copy()

boxes_xyxy[:, 0] = boxes[:, 0] - boxes[:, 2] / 2

boxes_xyxy[:, 1] = boxes[:, 1] - boxes[:, 3] / 2

boxes_xyxy[:, 2] = boxes[:, 0] + boxes[:, 2] / 2

boxes_xyxy[:, 3] = boxes[:, 1] + boxes[:, 3] / 2

sorted_indices = np.argsort(confs)[::-1]

boxes_xyxy = boxes_xyxy[sorted_indices]

confs = confs[sorted_indices]

classes = classes[sorted_indices]

for i, (box, conf, cls) in enumerate(zip(boxes_xyxy, confs, classes)):

x1, y1, x2, y2 = map(int, box)

class_id = int(cls)

object_data = {

'box': (x1, y1, x2, y2),

'detection_conf': conf,

'class_id': class_id,

'class_name': COCO_CLASSES[class_id]

}

objects.append(object_data)

return objects

def process_video_frame(frame, timestamp_ms, is_camera):

"""動画フレーム処理(標準形式)"""

current_time = time.time()

objects = detect_objects(frame)

global class_counts

for obj in objects:

name = obj['class_name']

if name not in class_counts:

class_counts[name] = 0

class_counts[name] += 1

frame = draw_detection_results(frame, objects)

result = format_detection_output(objects, is_camera, current_time)

return frame, result

def video_frame_processing(frame, timestamp_ms, is_camera):

"""動画フレーム処理(標準形式)"""

global frame_count

current_time = time.time()

frame_count += 1

processed_frame, result = process_video_frame(frame, timestamp_ms, is_camera)

return processed_frame, result, current_time

# プログラムヘッダー表示

display_program_header()

# ===== モデル選択 =====

while True:

print('使用するYOLOv12モデルを選択してください:')

for key, val in MODEL_INFO.items():

print(f" {key}: {val['name']} ({val['params']} params)")

choice = input("選択 (n/s/m/l/x): ").lower()

if choice in MODEL_INFO:

MODEL_SIZE = choice

break

else:

print("\n無効な選択です。もう一度入力してください。\n")

MODEL_NAME = f'yolo12{MODEL_SIZE}.pt'

print(f"\nモデル '{MODEL_INFO[MODEL_SIZE]['name']}' を使用します。\n")

# システム初期化

print('システム初期化中...')

if device.type == 'cuda':

print(f'GPU検出: {torch.cuda.get_device_name(0)}')

print(f'CUDA バージョン: {torch.version.cuda}')

try:

print(f'YOLOv12 ({MODEL_INFO[MODEL_SIZE]["name"]}) モデルを初期化中...')

model = YOLO(MODEL_NAME)

print(f'YOLOv12 ({MODEL_INFO[MODEL_SIZE]["name"]}) モデルの初期化が完了しました')

print(f'モデルサイズ: {MODEL_SIZE} ({MODEL_INFO[MODEL_SIZE]["name"]}={MODEL_INFO[MODEL_SIZE]["desc"]})')

except Exception as e:

print(f'YOLOv12 ({MODEL_INFO[MODEL_SIZE]["name"]}) モデルの初期化に失敗しました')

print(f'エラー: {e}')

print(f"ヒント: '{MODEL_NAME}' ファイルがプログラムと同じディレクトリに配置されているか確認してください。")

exit()

print('初期化完了')

print()

print("入力ソースを選択してください:")

print("0: 動画ファイル")

print("1: カメラ")

print("2: サンプル動画")

choice = input("選択: ")

is_camera = (choice == '1')

if choice == '0':

root = tk.Tk()

root.withdraw()

path = filedialog.askopenfilename()

if not path:

exit()

cap = cv2.VideoCapture(path)

elif choice == '1':

cap = ThreadedVideoCapture(0, is_camera=True)

else:

print('サンプル動画をダウンロード中...')

urllib.request.urlretrieve(SAMPLE_URL, SAMPLE_FILE)

cap = cv2.VideoCapture(SAMPLE_FILE)

if not cap.isOpened():

print('動画ファイル・カメラを開けませんでした')

exit()

# フレームレートの取得とタイムスタンプ増分の計算

if is_camera:

actual_fps = cap.get(cv2.CAP_PROP_FPS)

print(f'カメラのfps: {actual_fps}')

timestamp_increment = int(1000 / actual_fps) if actual_fps > 0 else 33

else:

video_fps = cap.get(cv2.CAP_PROP_FPS)

timestamp_increment = int(1000 / video_fps) if video_fps > 0 else 33

# メイン処理

print('\n=== 動画処理開始 ===')

print('操作方法:')

print(' q キー: プログラム終了')

start_time = time.time()

last_info_time = start_time

info_interval = 10.0

timestamp_ms = 0

total_processing_time = 0.0

try:

while True:

ret, frame = cap.read()

if not ret:

break

timestamp_ms += timestamp_increment

processing_start = time.time()

processed_frame, result, current_time = video_frame_processing(frame, timestamp_ms, is_camera)

processing_time = time.time() - processing_start

total_processing_time += processing_time

cv2.imshow(MAIN_FUNC_DESC, processed_frame)

print(result)

results_log.append(result)

# 情報提供(カメラモードのみ、info_interval秒ごと)

if is_camera:

elapsed = current_time - last_info_time

if elapsed >= info_interval:

total_elapsed = current_time - start_time

actual_fps = frame_count / total_elapsed if total_elapsed > 0 else 0

avg_processing_time = (total_processing_time / frame_count * 1000) if frame_count > 0 else 0

print(f'[情報] 経過時間: {total_elapsed:.1f}秒, 処理フレーム数: {frame_count}, 実測fps: {actual_fps:.1f}, 平均処理時間: {avg_processing_time:.1f}ms')

last_info_time = current_time

if cv2.waitKey(1) & 0xFF == ord('q'):

break

finally:

print('\n=== プログラム終了 ===')

cap.release()

cv2.destroyAllWindows()

if results_log:

with open('result.txt', 'w', encoding='utf-8') as f:

f.write('=== 結果 ===\n')

f.write(f'使用モデル: YOLOv12 {MODEL_INFO[MODEL_SIZE]["name"]} ({MODEL_NAME})\n')

f.write(f'処理フレーム数: {frame_count}\n')

f.write(f'使用デバイス: {str(device).upper()}\n')

if device.type == 'cuda':

f.write(f'GPU: {torch.cuda.get_device_name(0)}\n')

f.write(f'画像処理: CLAHE適用(YUV色空間)\n')

f.write(f'信頼度閾値: {CONF_THRESH}\n')

f.write(f'\n検出されたクラス一覧:\n')

for class_name, count in sorted(class_counts.items()):

jp_name = CLASS_NAMES_JP.get(class_name, class_name)

f.write(f' {jp_name} ({class_name}): {count}回\n')

f.write('\n')

f.write('\n'.join(results_log))

print(f'\n処理結果をresult.txtに保存しました')

print(f'検出されたクラス数: {len(class_counts)}')

![[kaneko lab.]](https://www.kkaneko.jp/info/logo_png.png)